Por CAVADA CABACH, FEDERICO .

El vertiginoso avance de la tecnología y el protagonismo que ha alcanzado la inteligencia artificial en la vida del hombre, junto con hacer posible cosas que antes solo podían soñarse, ha tenido como externalidad negativa un innegable impacto en la libertad de las personas.

La tecnología pareciera avanzar más rápido de lo que el hombre es capaz de acomodarse a ella, y el mundo militar no escapa a esta realidad.

Technology´s swift advance and the prominence that artificial intelligence has achieved in human life, along with making things possible that before could only be dreamed of, has had an undeniable negative impact on people’s freedom. Technology seems to advance faster than what man is able to adapt to, and the military world is no exception to this reality.

“En 20 metros gire a la derecha en calle tres Norte… Gire a la derecha en calle Tres Norte…”

¿Qué haría sin herramientas como Waze o Google Maps? ¿Cómo evitaría la congestión y los accidentes para llegar a tiempo a su destino?

Quienes aprendieron a manejar en la “era pre Waze” podrían responder, simplemente, que de la misma forma en que se hacía entonces. Utilizando el conocimiento de la ruta, la experiencia, la intuición y, aunque los menores de 21 años no lo crean, los mapas de papel.

Independiente de que hace 20 años el automovilista promedio no sintiera la necesidad de contar con estas herramientas tecnológicas, igualmente llegaron. Simplificaron la vida de millones de conductores, pero, colateralmente, los fueron transformando en simples interfaces entre la aplicación y el auto. El lector probablemente se ha visto más de alguna vez conduciendo mecánicamente por calles completamente desconocidas, mientras sigue, con fe ciega y al pie de la letra, las instrucciones que le entrega un algoritmo.

Estas aplicaciones de navegación han hecho que el hombre sea cada vez menos necesario en la conducción. Pronto, empresas tecnológicas como Tesla, Uber y Google se encargarán de eliminarlo por completo del proceso.

La Inteligencia Artificial (AI) ha aumentado vertiginosamente su protagonismo en las decisiones del hombre, lo que ha facilitado su vida, pero, al mismo tiempo, lo ha ido convirtiendo paulatinamente en espectador de muchos procesos que antes requerían de su participación. Como plantea Yuval Harari, ha afectado su libertad para elegir. Google News escoge las noticias que más “le interesan,” Spotify le recomienda música acorde con “sus gustos,” Facebook le sugiere “amigos” y Apple Health le dice qué comer para lograr “sus metas.” Todas recomendaciones que son seguidas “libremente,” pero sin pensarlo ni cuestionarse mucho.

La tecnología avanza más rápido de lo que parece posible aquilatar su impacto en la libertad, algo que en tiempos actuales se presenta como un tremendo desafío y el ámbito militar no escapa a ello.

Es imposible predecir el grado de control que la AI llegará a tener en las decisiones del hombre, pero es altamente probable que su injerencia vaya creciendo progresivamente. Ello llevará a que, en un futuro cercano, los líderes militares, les guste o no, deban realizar sus ciclos de toma de decisiones en los distintos niveles con un creciente apoyo de herramientas de AI, capaces de procesar millones de datos en forma casi simultánea y de recomendar cursos de acción de acuerdo con los objetivos planteados y el ambiente operacional reinante.

En este escenario, la experiencia, inteligencia e intuición del comandante serán todavía relevantes, pero probablemente existirá un “Waze Militar” que le recomendará una ruta. La pregunta es qué efectos tendrá la presencia de estas herramientas en la mente del tomador de decisiones y su equipo.

El presente artículo propone que la incorporación de AI al proceso de toma de decisiones militares, junto con constituirse en una significativa ayuda, podría también afectar la libertad de acción, de la misma forma en que ocurre con muchos otros aspectos de la vida cotidiana hoy en día.

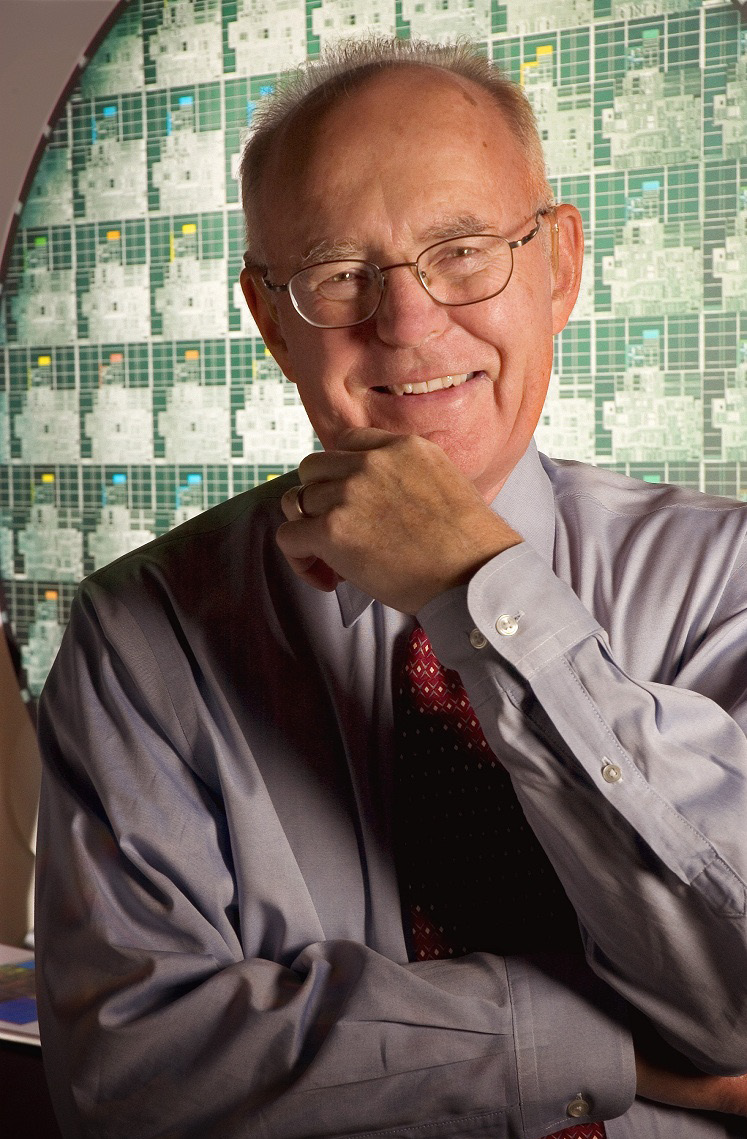

Gordon Moore

En 1965, el cofundador de Intel, Gordon Moore, postuló que la velocidad y capacidad de procesamiento de los microchips se duplicaría anualmente sin grandes aumentos de costo, regla que posteriormente actualizó a cada dos años. La denominada “ley de Moore” se ha cumplido con relativa exactitud por más de 50 años (Friedman, 2017, p. 25).

Todo el mundo se ha beneficiado del aumento en la capacidad de cómputo y bajo costo de los microprocesadores, que duda cabe. El problema está en que el hombre no duplica su capacidad de adaptarse a los cambios cada dos años, de hecho es bastante renuente a ellos…

La tecnología no da tregua. La “ley de Moore” sigue su paso inquebrantable, aumentando vertiginosamente la potencia del hardware que permite dar soporte a algoritmos cada vez más sofisticados, mientras el ser humano pareciera quedarse atrás en su esfuerzo por adaptarse.

Existe una pequeña y extraña satisfacción que inunda a un conductor cuando logra “ganarle al Waze” siguiendo un camino distinto al recomendado (al menos es lo que le sucede al autor). Es cierto que eso ocurre poco, pero ocasionalmente pasa. Al respecto, Harari plantea que, para entregar cada vez más poder de decisión a los algoritmos no es necesario que estos sean perfectos, solo que sean mejores tomadores de decisiones que el ser humano, cosa que al parecer ya se logró (Harari, 2017). Una lógica irrefutable. Pero, si el conductor normal le gana muy esporádicamente a Waze, el taxista o el conductor de Uber recomiendan de manera periódica a sus clientes seguir una ruta distinta en base a su experiencia e intuición.

Al respecto, el premio Nobel de economía, Daniel Kahneman, plantea que las decisiones rápidas, empleando lo que él denomina el “Sistema 1” del pensamiento, que son las basadas en emociones, experiencias y heurística,1 son susceptibles al entrenamiento, generando la capacidad de resolver de manera ágil y sin gran procesamiento mental en ciertos escenarios específicos (ello no significa que siempre de forma correcta). Kahneman ejemplifica esto justamente con profesiones como bomberos y militares, quienes muchas veces reconocen el peligro o la decisión correcta a través de la intuición, que no es más que la reacción mental a años de experiencia y entrenamiento, lo que permite identificar patrones familiares en situaciones nuevas (Kahneman, 2011).

Esa sensación de incomodidad que tiene el comandante cuando algo parece andar mal, al someter a sus subordinados a situaciones de riesgo, o al resolver sobre un curso de acción que no lo deja convencido y que lo hace cambiar de idea, no es un “sexto sentido mágico,” es intuición, construida a través de años de experiencia, repetición y entrenamiento. ¡Es el “Sistema 1” del pensamiento! Por tanto, el primer aspecto a tener presente respecto de la incorporación de AI en la toma de decisiones militares, es que podría reducir la exposición de actuales y futuros jefes a situaciones que permitan educar su intuición, al entregar “en bandeja” una solución con un alto porcentaje de probabilidad de éxito (nunca del 100%).

Así como Waze atrofia la capacidad de un automovilista de llevar su vehículo de un punto a otro, o iSailor fomenta la flojera del navegante, herramientas actuales y futuras podrían ir debilitando la capacidad de pensar rápido o con el Sistema 1, en aspectos cruciales de la toma de decisiones militares. Es decir, podrían imponer una traba al comandante, producto del debilitamiento de su competencia, limitando su libertad de acción.

Lo mismo podría decirse del pensamiento lento, el que está asociado al razonamiento más profundo y que requiere de concentración y esfuerzo. El “Sistema 2.”

En su artículo “¿Qué tan pensadores críticos somos?” el comandante Pelayo plantea la importancia de la formación de pensadores críticos y creativos en la Armada para enfrentar problemas militares cada vez más complejos. Al respecto señala, entre muchas otras características, que un pensador crítico es una persona que es precisa en la formulación de problemas, tiene la capacidad de recopilar y ponderar información y obtener conclusiones en base a estándares relevantes, siempre con mente abierta y bajo una rigurosa autorregulación, con la finalidad de mejorar constantemente su capacidad de pensamiento (Pelayo, 2020). Es decir, requiere de disciplina e interés personal por un perfeccionamiento constante, objeto sortear con éxito los complejos desafíos del hombre de armas del siglo XXI.

¿Pero qué pasaría con esa disciplina y entrenamiento mental –que en condiciones normales es difícil de obtener- si al alcance de la mano estuviera el algoritmo que propone soluciones a todos esos problemas complejos? ¿Será capaz el militar promedio de mantener su riguroso trabajo de perfeccionamiento intelectual o simplemente seguirá las recomendaciones del algoritmo igual como acepta las sugerencias de amistad de Facebook o la proposición de películas de Netflix?

De acuerdo con esto, un comandante podría ver limitada su libertad de acción por la carencia de un equipo de asesores que efectivamente sean pensadores críticos y creativos, debido a que las herramientas disponibles podrían facilitarles la vida a tal punto, que los lleven paulatinamente a un estado de sedentarismo intelectual.

Almirante de flota Chester W. Nimitz

Pasando ahora a aspectos culturales ¿Qué pasaría si el almirante Horacio Nelson fuera transportado a los tiempos actuales y ante la orden de un superior resolviera “poner su catalejo en el ojo ciego” y desobedecer a su jefe? ¿Sería ello celebrado independiente de lo positivo del resultado? ¿Qué hubiese ocurrido con el subteniente Chester Nimitz si en lugar de varar su buque en 1908, lo hubiese hecho en 2018? ¿Cree Ud. que hubiera alcanzado el grado de almirante de flota?

La cultura militar mundial ha tendido cada vez más a reducir la tolerancia al error, por motivos que pueden ser muy válidos, pero el hecho se mantiene. En una estructura jerárquica, con una carrera piramidal, se busca que los más idóneos lleguen arriba, lo que inevitablemente va marginando a quienes cometen equivocaciones en el camino. Este simple hecho puede afectar las decisiones de muchos líderes militares.

Del mismo modo, la responsabilidad del mando ante accidentes, malos resultados operativos o cuestionamientos de excesivo uso de la fuerza –muchas veces en situaciones extremadamente difíciles, que solo los militares parecen comprender - pueden tener, no solo implicancias administrativas, sino llegar hasta a judicializarse. Puede salir caro equivocarse.

A lo anterior, se podrían sumar aspectos cotidianos como el contar con estabilidad laboral y, por ende, tranquilidad y proyección familiar.

Todo esto, entre otras cosas, ha llevado a que los militares tiendan a desarrollar una cultura cada vez menos proclive al riesgo.

Con esta particular idiosincrasia en mente, imagine el siguiente escenario en el futuro (no lejano). Si un comandante de gran experiencia se ve en la disyuntiva de resolver una situación, en la cual sus asesores, sus conocimientos o simplemente su intuición lo hace estar convencido de seguir un camino “A,” pero el Waze Militar le recomienda, con un 68,24% de probabilidad de éxito, uno “B” ¿Qué hará?

Ese comandante cuenta con la experiencia, conocimientos e intuición propias de su grado e investidura –por algo es el comandante–. Es, guardando las proporciones, un símil del taxista de las aplicaciones de navegación terrestre. Está preparado para desafiar al Waze Militar, pero si se equivoca al hacerlo, podría ser cuestionado por no haber seguido las recomendaciones de la maravillosa herramienta de AI que, con gran costo para el erario nacional, el Estado ha puesto a su disposición. Si no lo hacen sus jefes militares, lo podría hacer la opinión pública a través de redes sociales – llenas de algoritmos manipulables – los políticos o el poder judicial… ¡¿Por qué no utilizó los sistemas de ayuda a la toma de decisiones que tenía disponibles?! Probablemente señalarían los cuestionamientos.

Quizás la solución propuesta por el Waze Militar era la mejor. Quizás no. Lo que sí es seguro, es que si el comandante resuelve seguir la recomendación del algoritmo, a pesar de no concordar con ella, por la implicancias que una decisión distinta podría acarrearle, perdió su libertad de acción. El que está decidiendo es el algoritmo y no el ser humano (si eso es mejor o peor, es otro tema).

Este argumento no pretende señalar que los militares en general actuarían de la forma señalada para evitar problemas posteriores, solo poner sobre la mesa que la presión existiría, afectando, en mayor o menor medida, la libertad para elegir.

Sin duda hay quienes contra argumentarán que los sistemas de AI son ayudas, que no harán otra cosa que hacer más eficientes las decisiones humanas, pero siempre estarán bajo la tutela y control del hombre. En opinión del autor, eso sería completamente cierto en un experimento de laboratorio, en condiciones ideales y al vacío, pero las decisiones de las personas se ven afectadas por mucho más que la simple pugna entre hombre y máquina.

Experiencias, preocupaciones, sentimientos, presiones, relaciones humanas y sesgos, hacen que el hecho de tener a disposición una herramienta para ser utilizada libremente no signifique que no afectará la libertad de elegir. Tan solo piense, por ejemplo, en Google. Nadie lo obliga a creer los primeros diez resultados que le presenta el buscador, pero la mayoría lo hace, ya sea por flojera, desconocimiento o poca disponibilidad de tiempo. Las herramientas más espectaculares que han sido creadas por el hombre para facilitar su vida, pueden también presentar alguna externalidad negativa. Haga el ejercicio de recordar cuántas veces le ha pasado en un banco u oficina que ha necesitado que se ejecute una acción particular, empleando un sistema informático en red. Simplemente hacer algo que a todas luces resulta lógico y que todos concuerdan que debe hacerse, pero la respuesta del operador o encargado es que no se puede, porque… Ponga atención… “el sistema no lo permite...” Esa herramienta informática que fue diseñada para ayudarle, no lo deja hacer lo que usted necesita… ¿Su libertad no fue acaso restringida por el sistema?

Distintos artículos y publicaciones de connotados especialistas plantean que los algoritmos nunca sustituirán al ser humano en aspectos tan complejos y multivariables como las empresas militares. Existen sólidos argumentos que sustentan esa tesis –también los hay para la postura opuesta– Pero lo que se propone en este escrito es algo muy distinto. El hecho de que sean un aporte por su capacidad de procesar información y proponer soluciones racionales de forma más rápida y eficiente que el hombre –y según Harari (2015), incluso respuestas emocionales de mejor manera que el homo sapiens– no elimina la posibilidad de que tengan otras externalidades negativas en la mente de un tomador de decisiones.

Quizás la pregunta no es quién gana, AI o inteligencia humana –interrogante que está de moda por estos días– sino que cómo afecta la primera a la segunda, objeto mirar a futuro acelerando la capacidad de adaptación del hombre para incorporar la tecnología de forma armónica a los procesos de toma de decisiones y reduciendo al mínimo sus externalidades negativas.

Tras leer los párrafos precedentes, podría parecerle que existe una animadversión por parte del autor en contra de la AI. ¡Todo lo contrario! Efectivamente ha hecho posibles cosas que antes solo se soñaban y ha facilitado considerablemente la vida del ser humano. ¡Viva la tecnología!

Ahora bien, si llegará a reemplazar al hombre en aspectos tan complejos como la guerra es algo difícil de predecir, pero, aunque ello ocurra, habrá un paso intermedio, en que ambas inteligencias deberán convivir. En ese escenario, la AI solo puede superar a la humana si el hombre pierde su libertad para elegir, quedando obligado, por su incapacidad, presiones, sesgos u otro motivo, a obedecer a los algoritmos.

Para que el líder militar conserve su libertad, lo primero es mantener a oficiales y personal competentes, independiente de las nuevas herramientas tecnológicas que puedan surgir. Está muy bien apoyarse, por ejemplo, en la cartografía electrónica para navegar, pero no está bien depender 100% de ella abandonando los procedimientos tradicionales. Esto no se debe a que la marina sea conservadora, sino a que esos métodos construyen intuición, obligan a mirar hacia afuera, conocer el entorno y cimentar la conciencia situacional. No es solo una buena práctica que otorga precisión, profesionalismo y seguridad a la navegación, sino que también un elemento formador.

Las fuerzas armadas deben potenciar la construcción de una intuición educada, exponiendo, a actuales y futuros tomadores de decisiones, a situaciones complejas en escenarios demandantes desde los niveles más bajos, manteniendo las herramientas tecnológicas como un apoyo, que deben ser usadas, pero no abusadas.

La formación de pensadores críticos y creativos debe, del mismo modo, ser un imperativo para la marina, con la finalidad de poder conformar equipos robustos, innovadores y cuestionadores, capaces de encontrar soluciones novedosas e inteligentes a problemas cada vez más complejos y de integrar la tecnología de manera complementaria a sus procedimientos, siguiendo sus recomendaciones solo cuando estas tienen lógica a la luz de un proceso intelectual riguroso. Se debe combatir el sedentarismo mental, potenciando la autorregulación, con la finalidad de contar con profesionales cada vez más competentes en los distintos niveles.

A lo anterior es necesario agregar un cierto grado de tolerancia al error. Esto no quiere decir aceptar la flojera, la irresponsabilidad o la incompetencia, sino entender que existen situaciones sumamente complejas y multivariables, en que tanto algoritmos como personas inteligentes y preparadas pueden obtener resultados negativos. La libertad para tomar decisiones depende de la competencia, cierto, pero también de la confianza que siente el líder, ya que esta le permitirá tomar el riesgo de no seguir la recomendación del Waze Militar cuando su profunda preparación, su equipo de pensadores críticos y creativos o su aguda y educada intuición lo recomienden. Esa confianza en sus conocimientos y en el respaldo de sus superiores, le permitirá “poner el catalejo en el ojo ciego” cuando lo estime necesario.

En síntesis, el desafío está en que el ser humano – en este caso el militar – sea capaz de adaptarse progresivamente al vertiginoso avance de la tecnología y no caer en la tentadora alternativa de acomodarse, perezosamente, a ella, perdiendo su libertad. No hay tiempo que perder, porque si hay algo que es seguro, es que la ley de Moore definitivamente no dará tregua.

&&&&&&&&&&

Federico,

Qué te puedo decir...extraordinario! La clave es precisamente ADAPTARSE y no ACOMODARSE, tal como tú lo mencionas; sin embargo, veo con preocupación precisamente aquello. Las generaciones actuales parecen "acomodarse" de una manera tremendamente preocupante, casi como sin siquiera saber que existe la alternativa de "adaptarse". Quizás porque es más fácil...

Un abrazo. Muy bueno el artículo...para variar.

El paradigma del combate naval ha experimentado una transformación en las últimas décadas (Naseem et al., 2017). La tran...

La estadística actual indica que los niveles de narcotráfico vía marítima han aumentado en Chile en los últimos años (Mi...

“El crimen organizado se combate como región o no se combate (Tohá, 2024)1" Miles de millones de personas utilizan...

¿Qué entendemos por “inteligencia”? Básicamente es la capacidad de abstraer, discernir, discriminar, aprender, crear, an...

“La inteligencia artificial es el futuro no solo para Rusia, sino para toda la humanidad. Trae consigo enormes oportunid...

Versión PDF

Año CXXXX, Volumen 143, Número 1009

Noviembre - Diciembre 2025

Inicie sesión con su cuenta de suscriptor para comentar.-